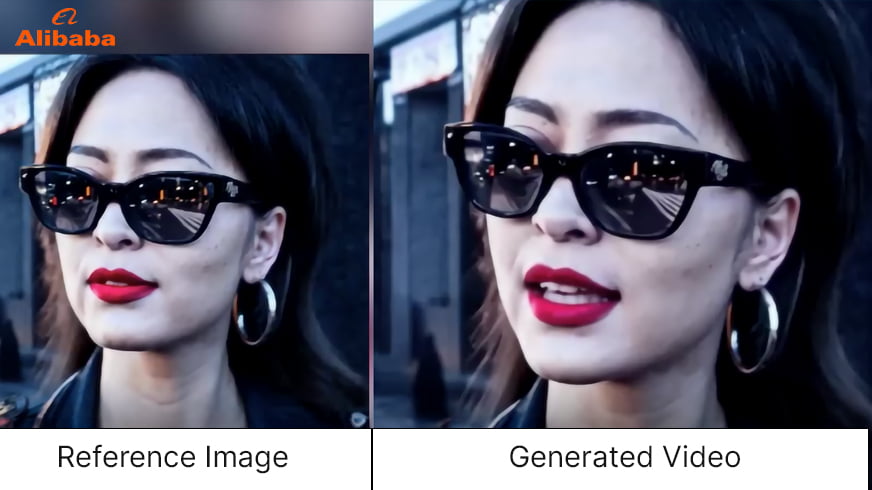

O Alibaba criou um novo sistema de IA chamado EMO (Emite Portrait Alive), que faz com que imagens se transformem em vídeos musicais ou cenas de conversas.

O sistema, descrito em um artigo de pesquisa publicado no arXiv, é capaz de criar movimentos faciais fluidos e expressivos e fazer com que a imagem reproduza áudios fornecidos para a IA. No vídeo de apresentação da ferramenta, é mostrado um vídeo da atriz Audrey Hepburn cantando uma música de Ed Sheeran, e uma mulher caracterizada como a Monalisa cantando Miley Cyrus.

“Técnicas tradicionais muitas vezes não conseguem capturar todo o espectro de expressões humanas e a singularidade dos estilos faciais individuais”, disse o autor Linrui Tian no artigo. “Para resolver essas questões, propomos o EMO, um novo framework que utiliza uma abordagem de síntese direta de áudio para vídeo, evitando a necessidade de modelos 3D intermediários ou pontos de referência faciais.”

O EMO tem uma tecnologia de modelo de difusão que facilita para o desenvolvimento de vídeos realistas com base em imagens fixas. Os pesquisadores treinaram o modelo com um conjunto de dados de mais de 250 horas de vídeos de cabeças falantes em filmes, programas de TV e concertos.

“Resultados experimentais demonstram que o EMO é capaz de produzir não apenas vídeos convincentes de fala, mas também vídeos de canto em vários estilos, superando significativamente as metodologias de última geração existentes em termos de expressividade e realismo”, afirma o artigo.

O problema dessa IA está no uso inadequado da ferramenta para espalhar desinformação e vídeos sem consentimento da pessoa. Os pesquisadores afirmam que planejam explorar métodos para detectar vídeos sintéticos.

Acesse aqui e saiba como você e o Startupi podem se tornar parceiros para impulsionar seus esforços de comunicação. Startupi – Jornalismo para quem lidera a inovação.